全国统一邮箱为:youclunwen@163.com

全国统一咨询电话为:0757-63959708 ;15899573055

注册地址为:注册地址为:广东省佛山市禅城区同济西路12号永丰大厦A座1211号

2.本网站承诺确保稿件质量,真诚为您服务,杜绝质量差的文章,为客户创造更高的价值。与您携手,创造更美好的明天。

基于机器视觉的株间机械除草装置的作物识别与定位方法

发布日期:2022-10-15 11:15:00摘 要:

株间机械除草技术可进一步减少化学除草剂的使用,有利于环境保护和农业可持续发展。为实现智能化的株间机械除草装置自主避让作物并进入株间区域,该研究提出了一种株间机械除草装置的作物识别与定位方法。利用2G-R-B 方法将作物 RGB 彩色图像进行灰度化,再选用 Ostu 法二值化、连续腐蚀和连续膨胀等方法对图像进行了初步处理。根据行像素累加曲线和曲线的标准偏差扫描线获得作物行区域信息,以作物行区域为处理对象,利用列像素累加曲线、曲线标准偏差和正弦波曲线拟合识别出作物,并结合二值图像中绿色植物连通域的质心获得作物位置信息。试验结果表明,该方法可以正确识别出作物并提供准确的定位信息,能适应不同天气状况、不同种类的作物,棉苗正确识别率为 95.8%,生菜苗正确识别率为 100%,该方法为株间机械除草装置避苗和除草自动控制提供了基本条件。关键词:农业机械,除草,定位,株间机械除草,机器视觉,作物识别引 言

近年来,国内外研究人员积极开展有益于环境保护、可促进农业持续发展的除草技术和设备的研究,以减少或取代被广泛使用的、对环境有害的化学除草剂,机械除草技术是一种备受关注的非化学除草技术,尤其是智能株间机械除草技术与装置[1-7]。利用机器视觉识别作物和杂草已成为研究热点。美国爱荷华州立大学利用立体摄像头提取景物深度信息,通过图像分割、骨架化等 8 个基本步骤,在实验室环境下识别出玉米植株中心[8]。Bossu 等[9]利用小波变换区别作物杂草,Alchanatis 等[10]利用多光谱特征区别杂草和作物,邓巍等[11]研究了基于支持向量机的玉米苗期杂草光谱图像识别方法,吴兰兰等[12-13]提出了利用支持向量机和分形维数来识别玉米和杂草,龙满生等[14]利用计算机视觉技术和人工神经网络技术对玉米苗期田间杂草识别进行了研究,朱宝国等[15]基于颜色特征研究了棉田杂草识别方法,毛文华等[16]研究了基于多特征的田间杂草识别方法。以上研究的目的主要是针对化学精确喷施,需要分辨的杂草种类繁多。株间机械除草与化学精确喷施不同,机械除草目标是保护作物除去杂草,通常只需识别出作物,其余均按杂草处理,无需分辨出杂草种类。目前适应株间机械除草的作物图像识别和定位研究还较少,Tillett 等[17]利用基于二维小波技术识别目标作物个体并获得坐标信息。张春龙等[18]在实验室内以最小时耗和最大包容准确度为目标,利用图像行像素直方图的参数组合确定苗株中心沿机器人前进方向的一维坐标,可满足试验要求。作物的识别以及作物与除草装置的位置关系是株间机械除草装置进行株间区域杂草控制和避免作物损伤的重要信息。为了给智能化株间机械除草装置提供作物位置信息,本文基于机器视觉技术,提出了一种株间机械除草作物识别与定位的方法,从二值图像中利用作物行内植株个体间的几何关系识别出作物,结合特定区域作物连通域质心实现作物定位,并选用棉苗和生菜苗进行了试验验证。

1 材料与方法

1.1 图像采集与处理

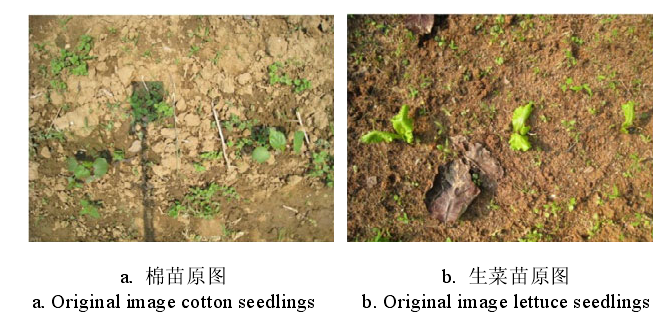

设备采集的棉苗图像和生菜苗图像共 120 张。其中,棉苗图像 80 张,用 CANON IXUS 860 CCD 数码相机于 2011 年 5 月在湖北省应城市黄滩镇拍摄,棉苗株距约 40 cm,拍摄时焦距为 5 mm,且尽量保证镜头垂直向下,与地面距离约 60 cm,图像大小为640×480 像素,格式为 JPG。生菜苗图像 40 张,用CANON IXUS 860 CCD 数码相机于 2011 年 10 月在华南农业大学试验田拍摄,生菜苗株距约 25 cm,拍摄方式、图像大小和格式与棉苗拍摄一致。图像处理软件采用MathWorks 公司的 MatlabR2010b,运行计算机为 Lenovo X220,Windows 7 64位操作系统,CPU 为 Intel i5-2410M,2.30 GHz。

1.2 图像分割

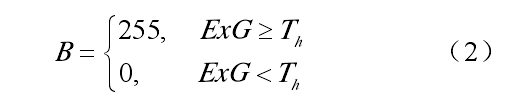

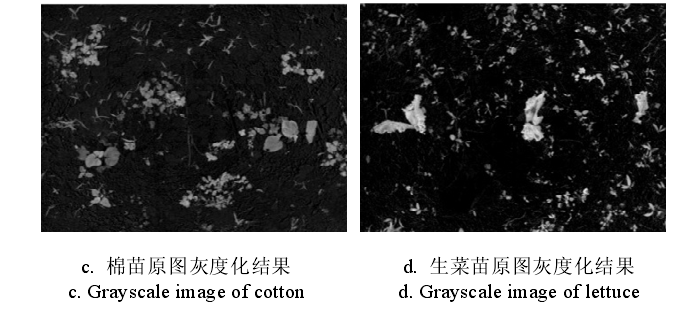

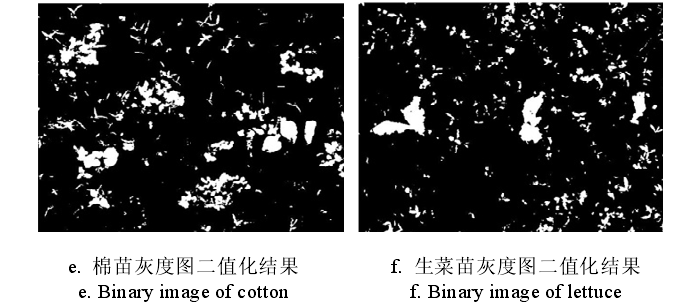

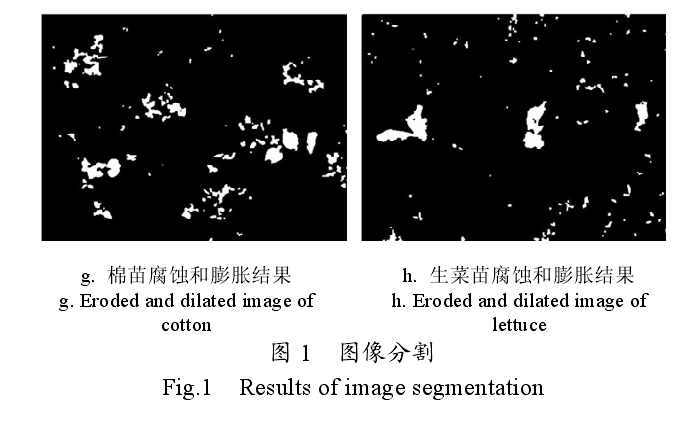

图像中的对象主要为植物(作物和杂草,颜色呈绿色)和背景(土壤、植物残渣和石头等,颜色以土壤的颜色为主),如图 1a 和图 1b 所示,图像处理时常将 24-bit 彩色图像的 RGB 各个分量进行适当的组合转化,以增强植物,抑制背景。对于作物识别或杂草的识别最常用的灰度化方法为超绿色法[19-23]。ExG=2G - R -B(1)超绿色提取绿色植物图像效果较好,阴影、枯草和土壤图像等均能较明显的被抑制,植物图像更为突出。棉苗图像和生菜苗图像经超绿色法灰度化的结果分别如图 1c 和图 1d 所示。为将植物和背景分割需先确定一个阈值,然后将每个像素点的灰度值和阈值相比较,根据比较的结果将该像素划分为植物或者背景。最大类间方差法(Ostu 法)不需要人为设定其他参数,是一种自动选择阈值的方法,其计算过程简单、稳定[24-26]。利用 Ostu 法计算出最优阈值 Th后可根据下式将图像分成植物和背景 2 个部分。

其中,B=0 为背景(黑色),B=255 为植物或噪声点(白色)。对超绿法灰度化后的棉苗图像和生菜图像利用Ostu 法计算出最优阈值并二值化后的结果分别如图 1e 和图 1f 所示,白色区域包括作物、杂草和噪声等。二值图像形态学腐蚀能较好地消除图像噪声和独立像素点,并可将部分交叉的杂草与作物分离[20],然而腐蚀操作同时也缩小了作物垂直投影面积,为保持作物的特征,将腐蚀后的图像经相同次数的膨胀操作可使体积恢复到原始大小。棉苗和生菜苗的二值图经连续 3 次腐蚀和膨胀后的结果分别如图 1g 和图 1h 所示。

1.3 目标作物信息提取与定位

1.3.1 作物行区域信息

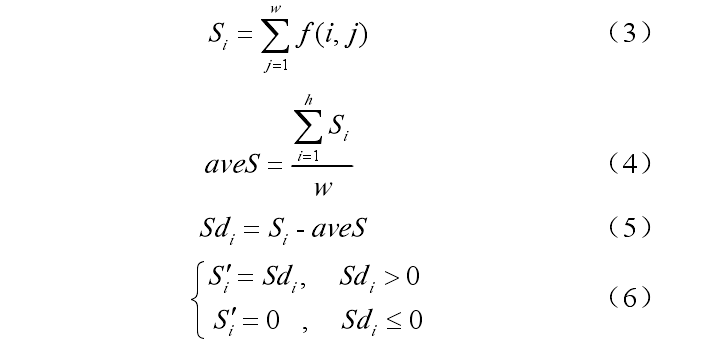

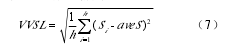

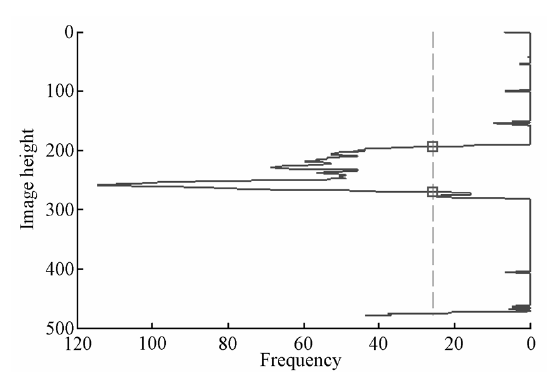

提取为获取作物行信息,将分割后的二值图像按各行向量分别累加(行像素直方图),由于行间区域杂草的影响,不能简单利用行像素直方图波峰或波谷划分出作物行区域,如图2 所示。作物行区域信息提取步骤如下:1)行像素累加及滤波将分割后的二值图像按各行向量分别累加,如式(3)所示,获得行像素直方图。为增强行像素直方图变化趋势,将各行累加和减去此幅图像的像素平均值,以分离轻度相交的杂草与作物。

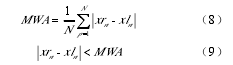

式中,Si为第 i 行像素累加和;i 为图像行序号;j为图像列序号;w 为图像宽度,像素;h 为图像高度,像素;f(i,j)为图像第 i 行第 j 列像素值;aveSi为第 i行像素平均值;Sdi为第 i 行像素累加和与像素平均值的差;S′i为第 i 行像素累加和经滤波后的值。2)作物行区域识别扫描线确定定义式(6)中 S′i的标准偏差[27]为作物行区域识别扫描值,垂直扫描线 VVSL 计算如式(7)所示。结果如图 2 中垂直的虚线所示。

作物行区域提取沿垂直扫描线,从上到下寻找出所有的目标区域,满足 S′i≥VVSL 和 S′i-1<VVSL 条件的点为区域n 起点边界 xrn,满足 S′i≤VVSL 和 S′i>VVSL 条件的点为区域 n 终点边界 xln。所有的目标区域中若相邻的两区域终点边界与起点边界距离小于目标区域的平均宽度 MWA 时将此两相邻目标区域合并为同一目标区域,如式(8)和式(9)所示。合并目标区域后根据新的目标区域数量重新计算目标区域的平均值,若新的目标区域宽度大于平均值,则认为此目标区域为作物行区域,该目标区域的起点边界为作物行区域起点边界,终点边界为作物行区域终点边界。若检测到多个作物区域,则认为最上端起点边界为作物行区域的起点边界,最下端终点边界为作物行区域的终点边界。

式中,MWA 为所有目标区域平均宽度,单位(像素);N 为目标区域个数;n 为目标区域序号;xrn为第 n 个目标区域起点边界;nxl 为第 n 个目标区域终点边界。按上述作物行区域识别方法提取的棉苗作物行区域和生菜苗作物行区域分别如图 2a 和图 2b所示。

a棉苗图像行像素直方图a. Histogram of cotton row pixelsb.

b. 生菜苗图像行像素直方图b. Histogram of lettuce row pixels注:实线为行像素累加和;虚线垂直扫描线;□为作物行区域边界点。Note: solid line stands for histogram of row pixels; dashed line stands forvertical scan line; □stands for

edge of crop row area.图 2 行像素直方图Fig.2 Histogram of row pixels

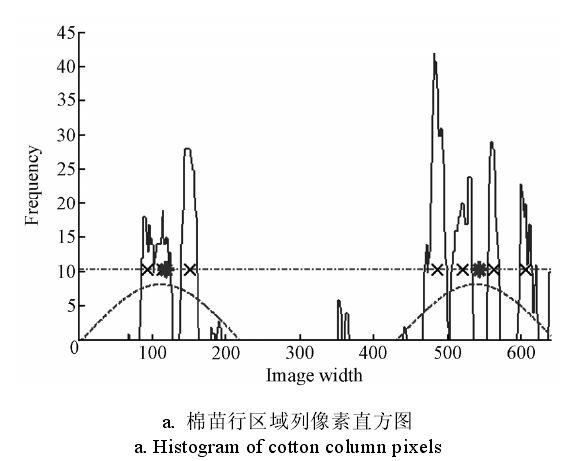

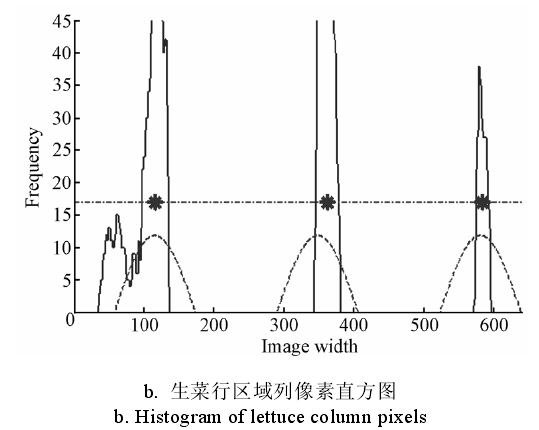

1.3.2 作物信息识别

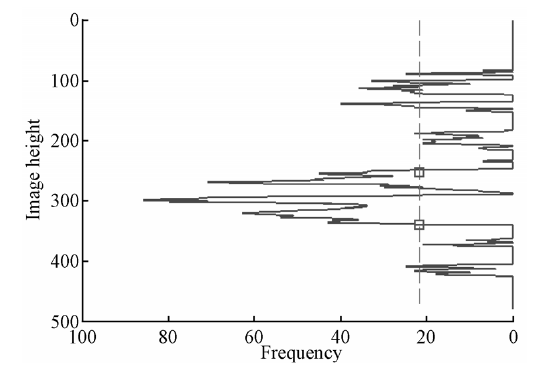

横坐标提取在分割后的二值图像中从作物行区域起点至终点将各列像素分别累加,获得作物行区域列像素直方图。同样,为分离轻度相交的杂草与作物,将各行累加和减去此幅图像的像素平均值。对于按一定株距播种或移栽的作物,其株距服从高斯分布[28]且可用高斯钟曲线作为作物行内作物位置的描述模型[29]然而利用高斯钟曲线拟合像素列向量累加曲线较复杂,运行速度较慢。Olsen[30]提出采用正弦波曲线方法拟合找出作物行的结构而提取作物行中心线,本研究利用正弦波曲线提取作物行内的作物,正弦波曲线函数 s为式(10)所示,式(11)用于只截取正弦波函数的正半部分。S=a sin(2πd)+b cos(2πd )(10)式中,a,b 为决定正弦波曲线函 s 数相位的参数,采用最小二乘法从累加和曲线中拟合得到;d 为图像中作物的株距,以像素为单位。以作物行区域列像素累加和曲线的标准偏差为扫描线找出区域宽度大于所有区域平均宽度的区域作为作物目标区域,并用目标区域的边界值计算出该目标区域的中心点,如图 3。利用所有目标区域的中心点通过最小二乘法求得正弦波曲线相位参数 a,b。若目标区域的中心点在正弦波曲线的正半波峰内则认为该目标区域为作物区域,而同一个正半波身内有多个目标区域时取中心点的平均值作为此株作物中心点,如图 3。

注:实线为列像素累加值;点线为水平扫描线;×为目标作物区域中心;虚线为正拟合曲线;*为作物横坐标中心点。Note: solid line stands for histogram of column pixels; dot-dashed linestands for horizontal scan line; ×stands for center of target region; dashedline stands for

fit curve; * stands for the center of target crop in horizontalordinate direction.图 3 作物行区域列像素直方图Fig.3 Histogram of column pixels within the row region

1.3.3 作物纵坐标提取

由于上一步的作物中心点纵坐标选取的是标准偏差,在图像中没有任何意义。作物应处于作物行区域内且横坐标在正弦波曲线的正半波峰内。为获得作物精确的纵坐标,本研究先将二值图像中作物行区域内的像素面积较大的绿色作物区域(即白色连通域)进行标记,并求得各连通域质心,然后将连通域质心的横坐标在同一正弦波曲线的正半波峰内的质心纵坐标归为同一组,取同组纵坐标的平均作为该株作物的纵坐标。

2 结果与分析

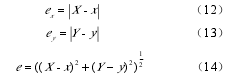

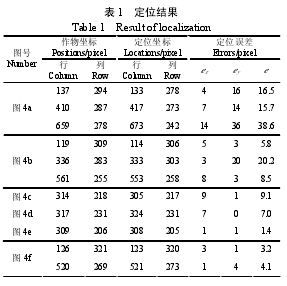

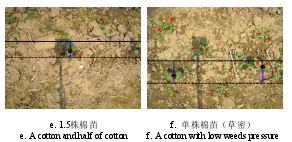

描述作物定位精确度,即作物在图像中的真实位置与图像处理识别定位出的位置之间的相差程度,定义作物位置为植物茎与土壤表面交点,并设式中, X为作物在图像中的真实位置行方向像素序号;Y 为作物在图像中的真实位置列方向像素序号;x 为图像处理识别出的作物位置行方向像素序号;y 为图像处理识别出的作物位置列方向像素序号;ex为行方向定位误差;ey为列方向定位误差;e 为定位误差。处理生菜图像时正弦波曲线拟合选取的生菜苗株距 d 为 116 个像素,每幅图像包含 3株生菜苗。图 4a 和图 4b 分别为晴天和阴天不同天气状况下采集的生菜图像的处理结果,其中图 4a 为图 1b 的处理结果。本方法能正确识别出作物行区域,即图中横向两直线间区域,并能正确识别出作物并获得作物位置,如图4a。2 幅生菜苗的定位结果见表 1。由表中生菜苗定位数据可以看出,虽在图 4a 和图4b 中生菜苗均被识别并定位,但每株生菜苗的定位都存在一定的误差。误差引起的主要原因是生菜苗叶片部分由于破损、虫害、遮挡、生长不均匀等并非对称分布,如图 4a 中从左至右第 3 株生菜苗,由于缺损了 1 片叶子,导致列方向定位误差 ey远大于 ex,且定位误差 e 达到 38.6 个像素点,而其余 2株生菜苗的定位误差在 16 个像素点左右。图 4b 中从左至右第 2 株生菜苗整体向图像下方方向生长,因此列方向误差 ey达到 20 个像素点,定位误差 e为 20.2 个像素点,而行方向误差 ex仅 3 个像素点。虽然本方法受生菜叶片生长等因素影响存在一定的误差,但能从所采集的 40 幅生菜图像中正确地识别出作物并获得作物位置信息,说明图像分割方法能适应晴天和阴天不同天气状况,作物识别和定位方法能达到预期效果。图 4c 至图 4f 为棉苗图像处理结果,正弦波曲线拟合选取的棉苗图像中株距 d 为 185 个像素,其中图 1a、图 2a 和图 3a 分别是图 4f 的原图、棉苗行区域提取过程和棉苗识别与定位过程。从图示棉苗图像处理结果可知,在不同密度的杂草环境中,单张图像中包括 1 株棉苗、1.5 株棉苗或 2 株棉苗的棉苗行区域均能被识别(即图中横向 2 直线间区域)并能正确识别出棉苗并获得其位置,如图 4,各棉苗的定位结果见表 1。由表中数据可知,棉苗的行方向定位误差 ex,列方向定位误差 ey和定位误差 e均小于 10 个像素点。

X为作物在图像中的真实位置行方向像素序号;Y 为作物在图像中的真实位置列方向像素序号;x 为图像处理识别出的作物位置行方向像素序号;y 为图像处理识别出的作物位置列方向像素序号;ex为行方向定位误差;ey为列方向定位误差;e 为定位误差。处理生菜图像时正弦波曲线拟合选取的生菜苗株距 d 为 116 个像素,每幅图像包含 3株生菜苗。图 4a 和图 4b 分别为晴天和阴天不同天气状况下采集的生菜图像的处理结果,其中图 4a 为图 1b 的处理结果。本方法能正确识别出作物行区域,即图中横向两直线间区域,并能正确识别出作物并获得作物位置,如图4a。2 幅生菜苗的定位结果见表 1。由表中生菜苗定位数据可以看出,虽在图 4a 和图4b 中生菜苗均被识别并定位,但每株生菜苗的定位都存在一定的误差。误差引起的主要原因是生菜苗叶片部分由于破损、虫害、遮挡、生长不均匀等并非对称分布,如图 4a 中从左至右第 3 株生菜苗,由于缺损了 1 片叶子,导致列方向定位误差 ey远大于 ex,且定位误差 e 达到 38.6 个像素点,而其余 2株生菜苗的定位误差在 16 个像素点左右。图 4b 中从左至右第 2 株生菜苗整体向图像下方方向生长,因此列方向误差 ey达到 20 个像素点,定位误差 e为 20.2 个像素点,而行方向误差 ex仅 3 个像素点。虽然本方法受生菜叶片生长等因素影响存在一定的误差,但能从所采集的 40 幅生菜图像中正确地识别出作物并获得作物位置信息,说明图像分割方法能适应晴天和阴天不同天气状况,作物识别和定位方法能达到预期效果。图 4c 至图 4f 为棉苗图像处理结果,正弦波曲线拟合选取的棉苗图像中株距 d 为 185 个像素,其中图 1a、图 2a 和图 3a 分别是图 4f 的原图、棉苗行区域提取过程和棉苗识别与定位过程。从图示棉苗图像处理结果可知,在不同密度的杂草环境中,单张图像中包括 1 株棉苗、1.5 株棉苗或 2 株棉苗的棉苗行区域均能被识别(即图中横向 2 直线间区域)并能正确识别出棉苗并获得其位置,如图 4,各棉苗的定位结果见表 1。由表中数据可知,棉苗的行方向定位误差 ex,列方向定位误差 ey和定位误差 e均小于 10 个像素点。

在所拍摄的 80 幅棉苗图像中,共 95 株完整棉苗,正确识别 91 株,其中 4 幅图像中各有 1 株未能正确识别和准确定位,正确识别率为 95.8%。未能正确识别和准确定位的原因:1)图像中局部杂草密度大,且靠近棉苗;2)个别棉苗长势慢,体积上明显小于其他棉苗。在定位方面,本方法能较准确地在图像中定位出作物位置,且对叶片分散的作物有一定优势,如试验选取的棉苗。然而,若以植物根或茎与土壤接触点为作物的真实位置,依靠作物叶片部位定位存在一定的误差,如图 4a 中从左至右第 3 株生菜,定位结果向图像上方偏离。引起误差的主要原因有叶片生长不均匀,作物倒伏生长和部分叶片缺失(虫害或腐烂等)等。

e. A cotton and half of cottonf. 单株棉苗(草密)f. A cotton with low weeds pressure注:上横直线为作物行区域上边界;下横虚线为作物行区域下边界;竖直线为提取的作物中心横坐标;*为获取到的作物中心位置;×为绿色植物连通域的质心。Note: the top edge of crop row area, the bottom edge of crop row area, thecenter of target crop in

horizontal ordinate direction, the center of targetcrop and the centroid of connected domains were

expressed

by

solid line,dashed line,vertical line,* and ×, respectively.图 4 作物识别与定位结果Fig.4 Results of recognition and localization

3 结论与讨论

本文提出了一种农田环境下株间机械除草所需的作物识别与定位方法。通过 2G-R-B 方法实现作物 RGB 彩色图像灰度化,再利用 Ostu 二值化、腐蚀和膨胀等方法对图像进行了初步处理。根据行像素累加曲线和曲线的标准偏差扫描线获得作物行区域信息,以作物区域为处理区域,利用列像素累加曲线、曲线标准偏差和正弦波曲线拟合识别出作物,并结合二值图像中绿色植物连通域的质心获得作物位置信息。试验结果表明,本方法可以正确识别出作物并提供准确的定位信息,生菜苗正确识别率为 100%,棉苗正确识别率为 95.8%,可作为株间机械除草控制提供作物位置信息的传感器。本方法在高密度杂草环境中和采用机器视觉技术通过叶片部位定位与根部实际位置仍存在误差,下一步拟利用连续多幅图像信息来减小杂草影响和缩小定位误差,并与株间机械除草装置结合,进行株间机械除草装置自动避让作物进行除草作业研究。

[参 考 文 献]

[1] O’Dogherty M J, Godwin R J, Dedousis A P, et al. Amathematical model of the kinematics of a rotating

discfor inter- and intra-row Hoeing[J]. BiosystemsEngineering, 2007, 96(2): 169-179.[2] N rremark M, Griepentrog H W, Nielsen J, et al. Thedevelopment and assessment of the accuracy of

anautonomous GPS-based system for intra-row mechanicalweed control in row crops[J]. Biosystems Engineering,2008, 101(4): 396-410.[3] Astrand B, Baerveldt A J. An agricultural mobile robotwith visionbased perception for mechanical

weedcontrol[J]. Autonomous Robots, 2002, 13(1): 21-35.[4] 张朋举,张纹,陈树人,等. 八爪式株间机械除草装置虚拟设计与运动仿真[J].农业机械学报,2010,41(4):56-59.Zhang Pengju, Zhang Wen, Chen Shuren. Virtual designand kinetic simulation for eight claw intra-rowmechanical weeding device[J]. Transactions of theChinese Society for Agricultural Machinery,

2010, 41(4):56-59. (in Chinese with English abstract)[5] 张春龙,黄小龙,耿长兴,等. 智能锄草机器人系统设计与仿真[J]. 农业机械学报,2011,42(7):196-199.Zhang Chunlong, Huang Xiaolong, Geng Changxing,et al. Design and simulation of intelligent

weedingrobot system[J]. Transactions of the CSAM, 2011,42(7): 196-199. (in Chinese with English

abstract)[6] 胡炼,罗锡文,严乙桉,等. 基于爪齿余摆运动的株间机械除草装置研制与试验[J]. 农业工程学报,2012,28(14):10-16.Hu Lian, Luo Xiwen, Yan Yi’an, et al. Development andexperiment of intra-row mechanical weeding devicebased on trochoid motion of claw tooth[J]. Transactionsof the Chinese

Society of Agricultural Engineering(Transactions of the CSAE), 2012, 28(14): 10-16. (inChinese with English abstract).[7] 胡炼,罗锡文,张智刚,等. 基于余摆运动的株间机械除草爪齿避苗控制算法[J]. 农业工程学报,2012,28(23):12-18.Hu Lian, Luo Xiwen, Zhang Zhigang, et al. Controlalgorithm for intra-row weeding claw device based ontrochoidal motion[J]. Transactions of the Chinese Societyof Agricultural

Engineering (Transactions of the CSAE),2012, 28(23): 12-18. (in Chinese with English abstract)[8] Jin J, Tang L. Corn plant sensing using real-time stereovision[J]. Journal of Field Robotics, 2009, 26(6): 591-608.[9] Bossu J, Gée C, Jones G, et al. Wavelet transform todiscriminate between crop and weed in

perspectiveagronomic images[J]. Computers and Electronics inAgriculture, 2009, 65(1): 133-143.[10] Alchanatis V, Ridel L, Hetzroni A. Weed detection inmulti-spectral images of cotton fields[J]. Computers andElectronics in Agriculture, 2005, 47(6): 243-260.

[11] 邓巍,张录达,何雄奎,等. 基于支持向量机的玉米苗期田间杂草光谱识别[J]. 光谱学与光谱分析.

2009,29(7):1906-1910.Deng Wei, Zhang Luda, He Xiongkui, et al. SVM-Basedspectral recognition of corn and weeds at seedling stagein fields[J]. Spectroscopy and Spectral

Analysis, 2009,29(7): 1906-1910. (in Chinese with English abstract)[12] 吴兰兰,刘俭英,文友先,等. 基于支持向量机的玉米田间杂草识别方法[J]. 农业机械学报,2009,40(1):162-166.Wu Lanlan, Liu Jianying, Wen Youxian, et al. Weedidentification method based on SVM in the

corn field[J].Transactions of the Chinese Society for AgriculturalMachinery, 2009, 40(1): 162-166. (in Chinese withEnglish abstract)[13] 吴兰兰,刘俭英,文友先. 基于分形维数的玉米和杂草图像识别[J]. 农业机械学报,2009,40(3):176-179.Wu Lanlan, Liu Jianying, Wen Youxian. Imageidentification of corn and weed based on

fractaldimension[J]. Transactions of the Chinese Society forAgricultural Machinery, 2009, 40(3):

176 - 179. (inChinese with English abstract)[14] 龙满生,何东健. 玉米苗期杂草的计算机识别技术研究[J]. 农业工程学报,2007,23(7):139-144.Long Mansheng, He Dongjian. Weed identification fromcorn seedling based on computer vision[J].

Transactionsof the Chinese Society of Agricultural Engineering(Transactions of the CSAE), 2007,

23(7): 139-144. (inChinese with English abstract)[15] 沈宝国,陈树人,尹建军,等. 基于颜色特征的棉田绿色杂草图像识别方法[J]. 农业工程学报,2009,25(6):163-167.Shen Baoguo, Chen Shuren, Yin Jianjun, et al. Imagerecognition of green weeds in cotton

fields based on colorfeature[J]. Transactions of the Chinese Society ofAgricultural Engineering

(Transactions of the CSAE),2009, 25(6): 163 - 167.( in Chinese with Englishabstract)[16] 毛文华,王一鸣,张小超. 基于机器视觉的苗期杂草实时分割算法[J]. 农业机械学报,2005,36(1):83-86.Mao Wenhua, Cao Jingjing, Jiang Honghua,et al. In-fieldweed detection method based on multi-features[J].Transactions of the Chinese Society of AgriculturalEngineering (Transactions of the CSAE),

2005, 36(1): 83-86. (in Chinese with English abstract)[17] Tillett N D, Hague T, Grundy A C, et al. Mechanicalwithin-row weed control for transplanted crops usingcomputer vision[J]. Biosystems Engineering,

2008, 99(2):171-178.[18] 张春龙,黄小龙,刘卫东,等. 苗间锄草机器人信息获取方法的研究[J]. 农业工程学报,2012,28(9):142-146.Zhang Chunlong, Huang Xiaolong, Liu Weidong, et al.Information acquisition method for

mechanical intra-rowweeding robot[J]. Transactions of the Chinese Society ofAgricultural Engineering (Transactions of

the CSAE), 2012,28(9): 142-146. (in Chinese with English abstract)[19] Woebbecke D M, Meyer G E, Bargen K V, et al. Colorindices for weed identification under various

soil,residual, and lighting conditions[J]. Transactions of theASAE, 1995, 38(1): 259-269.[20] Ldamm R D, Slaughter D C, Giles D K. Precision weedcontrol system for cotton[J]. Transactions

of the ASAE,2002, 1(45): 231-238.[21] Blasco J, Aleixos N, Roger J M, et al. Robotic weedcontrol using machine vision[J]. Biosystems

Engineering,2002, 83(2): 149-157.[22] 张勤,黄小刚,李彬. 基于彩色模型和近邻法聚类的水田秧苗列中心线检测方法[J]. 农业工程学报,2012,28(17):163-171.Zhang Qin, Huang Xiaogang, Li Bin. Detection of riceseedlings rows’centerlines based on color

model andnearest neighbor clustering algorithm[J]. Transactions ofthe Chinese Society of Agricultural

Engineering(Transactions of the CSAE), 2012, 28(17): 163-171. (inChinese with English abstract)[23] S gaard H T, Olsen H J. Determination of crop rows byimage analysis without segmentation[J].

Computers andElectronics in Agriculture, 2003, 38(2): 141-158.[24] 张铮,王艳平,薛桂香. 数字图像处理与机器视觉-VisualC++与 Matlab实现[M]. 北京:人民邮电出版社,2010.[25] 陈娇,姜国权,杜尚丰,等. 基于垄线平行特征的视觉导航多垄线识别[J]. 农业工程学报,2009,25(12):107-113.Chen Jiao, Jiang Guoquan, Du Shangfeng, et al. Crop rowsdetection based on parallel characteristic

of crop rows usingvisual navigation[J]. Transactions of the Chinese Societyof Agricultural Engineering

(Transactions of the CSAE),2009, 25(12): 107-113. (in Chinese with English abstract)[26] 曹倩,王库,李寒. 基于机器视觉的旱田多目标直线检测方法[J]. 农业工程学报,2010,26(Supp.1):187-191.Cao Qian, Wang Ku, Li Han. Detection algorithm for croptarget multi-lines of the field image based on machinevision[J]. Transactions of the Chinese Society ofAgricultural

Engineering (Transactions of the CSAE), 2010,26(Supp.1): 187-191. (in Chinese with English abstract)[27] Zhang H, Chen B, Zhang L. Detection algorithm for cropmulti-centerlines based on machine vision[J].Transactions of the ASABE, 2008, 51(3):1089-1097.[28] Bontsema J, Asselt C J, Lempens P W J, et al. Intra-rowweed control: A mechatronic approach[C]// 1st IFACWorkshop on Control Applications and

Ergonomics inAgriculture, Athens, Greece, 1998, 6.[29] strand B, Baerveldt A J. Plant recognition andlocalization using context information[C]//

Mechatronicsand Robotics –special session Autonomous Machines inAgriculture, Aachen, Germany, 2004.9.[30] Olsen H J. Determination of row position in small graincrops by analysis of video images[J].

Computers andElectronics in Agriculture, 1995, 12(2): 147-162.Plant recognition and localization

for intra-row mechanical weedingdevice based on machine visionHu Lian1,2, Luo Xiwen1,2※, Zeng

Shan1,2,

Zhang Zhigang1,2, Chen Xiongfei1,2, Lin Chaoxing1,2(1. Key Laboratory of Key Technology on

Agricultural Machine and Equipment, Ministry of Education, South China AgriculturalUniversity,

Guangzhou 510642, China; 2. College of Engineering, South China Agricultural University,

Guangzhou 510642,China)Abstract: Intra-row mechanical weeding, as a non-chemical weed control technology, reduces the application ofchemical herbicides and is beneficial

to the environment protection and sustainable development for agriculture aswell. Most crops are

ultivated in rows with a defined sowing or transplanting pattern, i.e. with a constant spacingdistance.

This is an important feature that can be used for plant recognition and localization. The goal of this

studypresented herein is to propose a recognition and localization approach, taking advantage of

the knowledge of thesowing or transplanting pattern, to avoid crop automatically and enter into the

intra-row area for intelligentintra-row mechanical weeding device. The RGB imaged plants were distinguished from soil by analyzing

theexcessive green (2G-R-B) vegetation index image. The Ostu algorithm method was employed to transform a grayimage

to a binary image. And then the binary image was dilated and eroded three times repeatedly to removeisolated

pixels in binary images or to remove noise for subsequent analysis. The standard deviation of

longitudinalhistogram was used as the scanning line to get the crop row area information in a

binary image. The next step wasto sum up all pixels of the crop row area per column, thus forming

a signal with a frequency that corresponds tothe average crop distance. The target regions and center

points were obtained by analyzing the lateral histogramwith the horizontal scan line. The most probable

crop regions were filtered from all the target regions using asinusoid which was fitted lateral histogram

based on the distance between crops. The phasing of the sinusoid wasgiven by least square fit for all the

center points. After fusing the center of crop row and the centroid of greenplants in binary image, the

plants localization were obtained through searching the closest fusion result to thesinusoid peeks. Test r

esults showed that, the method was sufficient in plants recognition and localization forintra-row mechanical weeding under different weather and field conditions. The accurate identification rate

was95.8% with the absolute error of 4.2 pixels in the x-direction and 1.4 pixels in the y-direction for cotton seedlings.An identification rate of 100% with the absolute error of 6.8 pixels in the

x-direction and 15.3

以上内容由论文代写网-优创网整理发布,详情请浏览http://www.youclunwen.com